スタンプを8枚作ろうとして、最初につまずいたのは「どの8つにするか」でした。

「ありがとう」は絶対入れたい。でも「了解」と「わかった」は別々に要る?「がんばれ」は送る場面が多いけど、「ごめん」も欲しい。そうやって考え始めると、家族の笑顔をどう生成するかより先に、「このセットで何を伝えたいか」という企画の問題があることに気づきます。

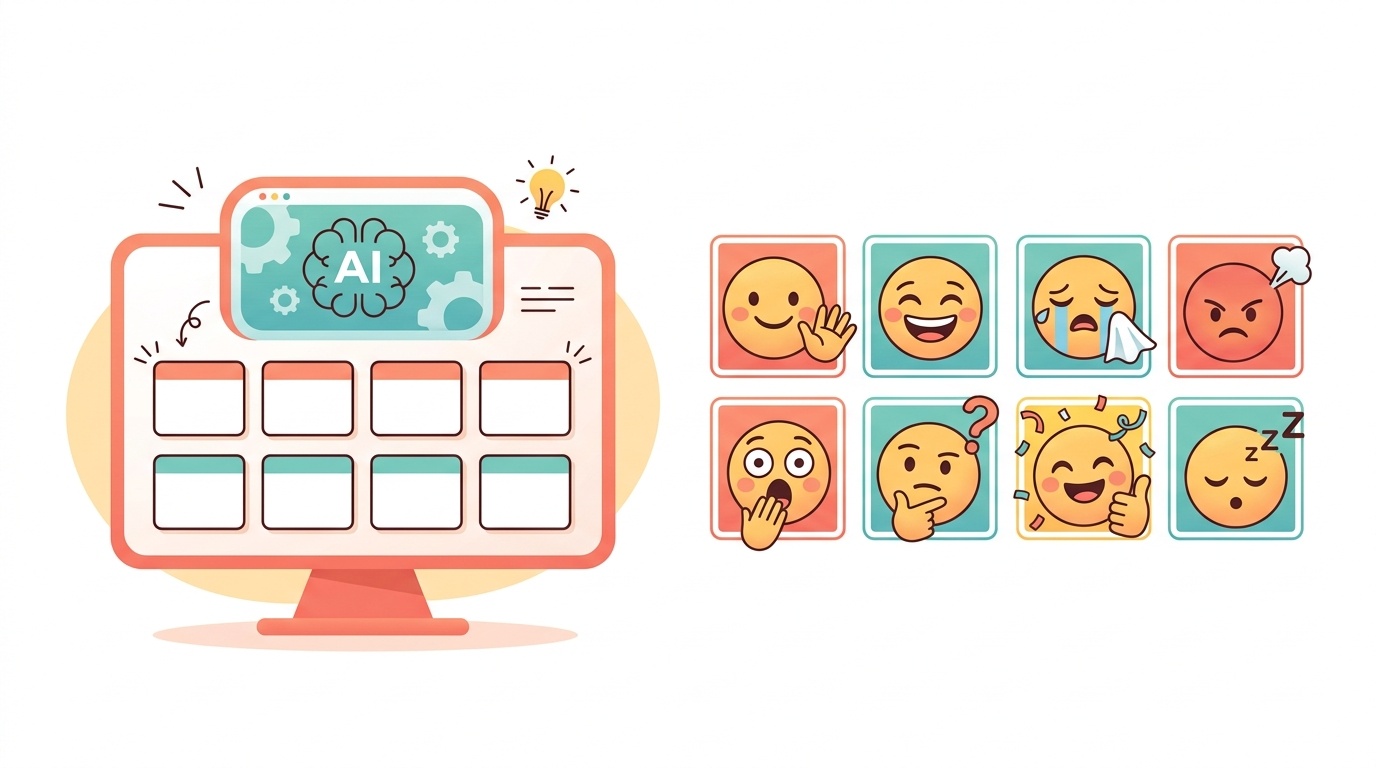

今回、2026年4月21日にOpenAIが案内したChatGPT Images 2.0 の Thinking を使って家族写真ベースのスタンプ案を作ってみたところ、絵のきれいさよりも「8ポーズの設計を先に任せられた」ことが一番効きました。この記事では、体験として書ける部分と公式情報で確認できる部分を分けながら、手順・プロンプト・LINE要件をまとめます。

まず驚いたのは、絵のきれいさより「8ポーズの決め方」だった

LINE Creators Marketの制作ガイドラインによると、通常スタンプは 8 / 16 / 24 / 32 / 40 個から枚数を選べます。販売できる最小セットは8個です。

この「8」という数が、今回のポイントでした。

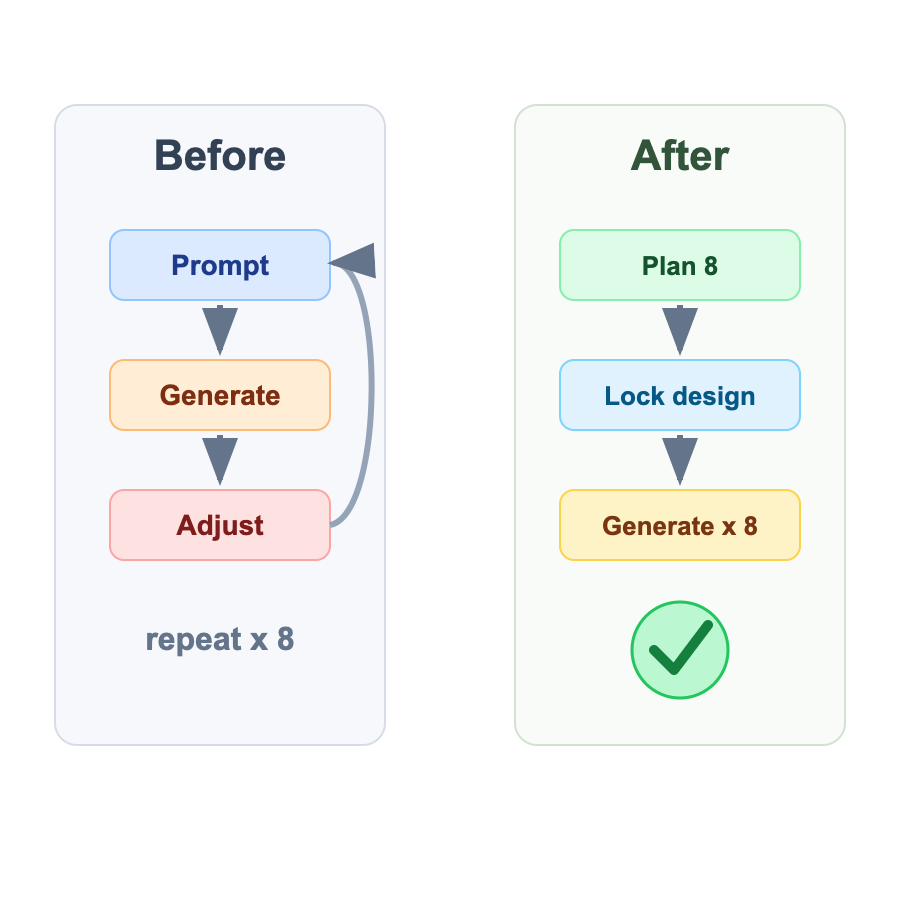

以前の画像生成AIで同じことをしようとしたとき、手順はこうでした。

- 1枚目の「ありがとう」用プロンプトを書く

- 出力を見て顔の細部・服・背景を調整する

- 2枚目の「了解」用に微修正したプロンプトで再生成する

- また微妙にキャラクターの顔が変わったので再調整する

- 8枚繰り返す

これは「8枚完成させる」作業ではなく、「毎回1枚を完成させる」作業の繰り返しです。セット全体の統一感は最後まで運任せでした。

今回やってみた順番は違います。画像を1枚も生成する前に、まずThinkingに「8つの感情案とスタンプ用テキスト」をテキストで出してもらいました。 Thinkingは演出家のように「このセットなら日常会話をカバーできる」という設計図を先に示してくれます。その設計図を固定してから、初めて画像生成に入ります。

GPT-image-2 / ChatGPT Images 2.0 で公式に確認できること

混乱しやすいので整理しておきます。

ChatGPT Images 2.0 は、2026年4月21日にOpenAIが案内した ChatGPT UI 上の機能名です。一方、開発者向けの API Docs に掲載されているモデル名は gpt-image-2 です(OpenAI API Docs)。SNSや記事では両方が同じ意味で使われることがありますが、「ChatGPTで使う機能」と「APIでコードから呼ぶモデル」は別の文脈です。

OpenAI Help Center によると、ChatGPT Imagesの基本機能は全ChatGPTプランで利用できます。ただし、images with thinking(Thinkingを使った画像生成)については、リリースノート(2026年4月21日付け)に有料プランでThinking / Proモデルを選択したときの機能として説明されています。今回試したのはこのThinking有効時の体験です。

また、ChatGPT Images 2.0 System Cardでは、OpenAIが高いリアリズムを持つ画像生成モデルの特性として、実在人物に関してより説得力のある偽造表現を作れてしまうリスクを指摘しています。家族写真を参照するときには、後述する同意・肖像権の問題とセットで意識する必要があります。

家族写真をスタンプ化するとき、Thinking に任せると楽になった部分

Thinkingがなぜ「演出家」に感じられたかを、Before / After で整理します。

Before: 一枚ずつ詰めていた方法

- 「ありがとう、笑顔、両手を合わせる」とプロンプトに書いて生成。

- 次の枚数は「了解、うなずき、同じ人物」で生成するが、少し顔つきが変わる。

- 微調整のためにプロンプトを細かく書き足す。試行錯誤が続く。

セットとしての整合は最後まで不確かで、「まあこれでいいか」と妥協することが多かったです。

After: 先に8ポーズの設計図を作ってから入る

- テキスト指示だけで「日常LINEで使いやすい8つの感情と一言テキスト案」をThinkingに出してもらう。

- 出力を確認・微調整して設計を固定する。

- 固定した設計に沿って、キャラクター方針(デフォルメ方式、輪郭スタイル、服装)を加えて生成する。

体験として言えるのは、入口で「何を作るか」が整理されている分、生成後の迷いが減ったことです。ポーズの意味がズレていると感じたときも、設計図が基準になるので修正の方向が明確でした。

Thinkingが「考えてから描く」モードであることは、ChatGPT Images 2.0 System Cardにも reasoning と tool use が加わる旨の説明があります。ただし「必ずキャラクターの顔が一致する」「必ず8枚で完成する」といった保証があるわけではなく、あくまで今回の使い方での実感として読んでください。

そのまま使える8ポーズ構成とプロンプト例

8ポーズ案

下記は今回Thinkingが提案した8案をベースに整理したものです。日常的なLINE会話を想定しています。

| ポーズ番号 | 感情・場面 | スタンプ用テキスト案 |

|---|---|---|

| 1 | 朝の挨拶 | おはよう |

| 2 | 感謝 | ありがとう |

| 3 | 承諾 | 了解! |

| 4 | 謝罪 | ごめん |

| 5 | 応援 | がんばれ! |

| 6 | ねぎらい | おつかれ |

| 7 | 驚き | びっくり |

| 8 | 就寝 | おやすみ |

8個はLINE通常スタンプの最小セット数と一致しているので、このリストをそのまま設計図として使えます。

プロンプト例:Step 1:感情設計(テキストのみ)

最初は画像を出さず、感情設計だけをThinkingに依頼します。

LINEスタンプ用に、日常会話でよく使われる8つの感情・場面をリストアップしてください。

各感情に対して、スタンプ画像に重ねる短い日本語テキスト案(3〜5文字程度)も提案してください。

キャラクターのベースは以下の人物特徴を想定します:

[ここに人物の特徴を文章で記載。例:「ショートヘア、丸顔、眼鏡あり、30代女性」]このステップで出力された8案を確認・修正してから、次のステップに進みます。

プロンプト例:Step 2:画像生成

設計を固定したら、キャラクター方針と画像要件を加えて生成します。

上記の設計に沿って、[感情名] の感情を表現するLINEスタンプ画像を1枚生成してください。

キャラクター設定:

- 写真の人物を直接コピーせず、特徴を抽出したデフォルメキャラクター

- 太い輪郭線、カラフルだが落ち着いたパレット

- 全8枚で同一キャラクターに見える統一感を意識

画像仕様:

- PNG、背景は白(後で透過処理するため)

- 四辺に十分な余白(スタンプ使用時に見切れないよう)

- テキスト「[スタンプ用テキスト]」を読みやすい太丸ゴシック体で画像内に配置

感情: [感情名]

テキスト: [スタンプ用テキスト]8枚分、同じキャラクター設定を維持したまま同一会話内で繰り返すと一貫性が出やすい印象でした(あくまで体験として)。生成後は必ず表情・テキストの一貫性を目視確認してください。

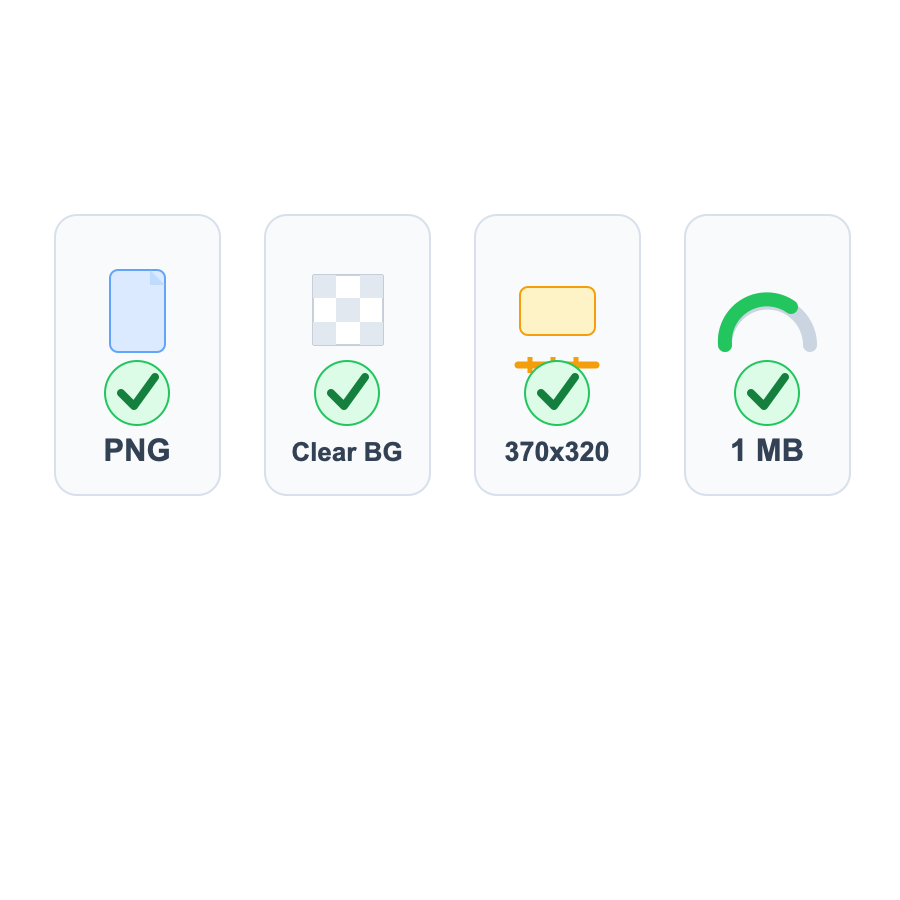

LINEスタンプにする前に見るべき公式要件

完成した画像をそのまま提出できるわけではありません。LINE Creators Market 制作ガイドラインに定められた要件を確認してください。

スタンプ枚数の選択肢

通常スタンプは 8 / 16 / 24 / 32 / 40 個から選びます。最小の8枚セットから始めるのが手間が少ないです。

画像ファイルの主な要件

| 項目 | 要件 |

|---|---|

| ファイル形式 | PNG |

| 背景 | 透明(アルファチャンネルあり) |

| 最大サイズ | 370 × 320 ピクセル |

| ファイルサイズ | 1枚 1 MB 以下 |

ChatGPTで生成した画像は背景が白で出ることが多いため、別途PNG透過処理が必要です。また、LINEのサイズ上限に合わせたリサイズも必要になります。

そのほかの提出アセット

スタンプ本体のほかに、タブ画像(96×74ピクセル)やチャット画像なども用意する必要があります。詳細は制作ガイドラインで確認してください。

家族写真だからこそ、同意と肖像権は軽く見ない

家族写真をベースにスタンプを作る楽しさは本物ですが、公開・販売・配布を検討する段階になった途端、話は変わります。

LINE Creators Marketの審査ガイドラインでは、本人の同意なしに他人の顔写真や似顔絵を使うなど、肖像権を侵害するコンテンツは拒否・販売停止の対象になり得ると説明されています。

特に注意が必要な点を整理します。

- 子どもが写っている場合: 親権者であっても、子どもの画像を公開・販売に使うことには慎重な判断が必要です。

- 本人の同意: スタンプに写っている人全員(家族・友人を問わず)から、「この目的で公開・販売するために使う」ことの同意を取ることが原則です。

- 似顔絵の扱い: 写真から生成したデフォルメキャラクターも、本人と識別できる場合は肖像権の対象になり得ます。

ChatGPT Images 2.0 System CardでもOpenAIは、高いリアリズムを持つ画像生成モデルが実在人物に関して説得力のある偽造表現を作るリスクを指摘しています。家族写真のような実在人物を参照するケースでは、この点を念頭に置くことが特に重要です。

今回の体験は、個人的なスタンプ案を検討する目的で試したものです。公開・販売を考える場合は、OpenAIの利用ポリシーとLINEの審査ガイドラインをそれぞれ確認した上で判断してください。

まとめ: GPT-image-2は一枚絵より「セット物」で面白い

今回の体験で感じたのは、ChatGPT Images 2.0(gpt-image-2)の面白さは「一枚の絵がきれいになった」よりも、「セット全体を設計してから作れる」ことにある、ということです。

Thinkingが先に8ポーズの企画を出してくれるおかげで、「何を生成するか」と「どう生成するか」を分けて考えられます。LINEスタンプのようにセット統一が求められる用途で、この設計先行の流れはとくに効果的でした。

試してみたい方向けに、実行前チェックリストをまとめます。

LINEスタンプ化の前に確認するチェックリスト

準備

- スタンプの使用目的を決める(個人利用のみ / 配布 / 販売)

- 公開・販売する場合は、写っている全員の同意を取る

- 子どもの画像の公開・販売については特に慎重に判断する

生成

- Step 1: まずテキストで8ポーズの感情設計を出してもらう

- 設計を確認・修正してから画像生成に入る

- images with thinking を使う場合は有料プラン・Thinking/Proモデルを選択する

- 8枚すべてでキャラクターの顔・服の一貫性を確認する

- 表情の違いがスタンプとして分かりやすいか確認する

- 日本語テキストの誤字・読みやすさを確認する

LINE提出前

- 背景を透過処理する(PNG、アルファチャンネルあり)

- 370 × 320 ピクセル以下にリサイズする

- ファイルサイズが1枚 1 MB 以下であることを確認する

- タブ画像(96×74ピクセル)など必要なアセットを用意する

- LINE Creators Market 制作ガイドラインと審査ガイドラインを最終確認する

参考・出典

- Introducing ChatGPT Images 2.0 – OpenAI(2026年4月21日)

- GPT Image 2 Model – OpenAI API Docs

- Images in ChatGPT – OpenAI Help Center

- ChatGPT Release Notes – OpenAI Help Center

- ChatGPT Images 2.0 System Card – OpenAI Deployment Safety Hub

- LINE Creators Market – Creation Guidelines – LINE Creators Market

- LINE Creators Market – Review Guidelines – LINE Creators Market

コメント