ChatGPT 5.5 Codex 新機能 は、AIが「提案するだけのツール」から「実際に作業を完遂するエージェント」へ転換した瞬間を象徴しています。コストはどれくらいか、セキュリティリスクはあるか、実際に現場で使えるのか——そうした疑問に答えるため、この記事では最新の公式情報をもとに、開発ワークフローがどう変わるかを実務目線で整理します。

関連記事: Claude Code Coworkとは:マルチエージェントの使い方

ChatGPT 5.5とCodex新機能の全体像

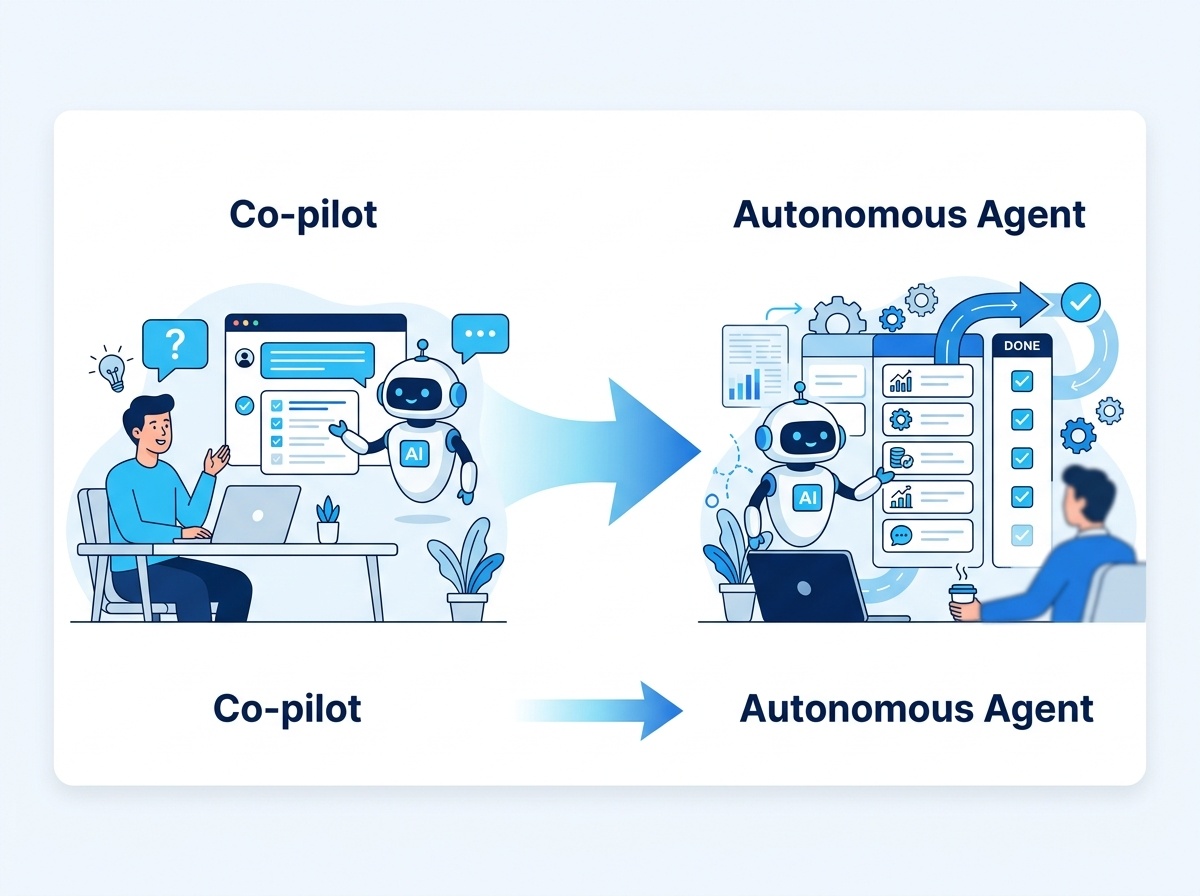

副操縦士から自律エージェントへ何が変わったのか

2026年4月23日、OpenAIは「GPT-5.5」を正式発表しました。これ以前のモデルは「副操縦士」として人間の指示に応じて提案をするものでした。しかし、GPT-5.5は計画・ツール選択・作業確認・エラー修正までを自律で完結させる設計へ転換しています。

具体的には、複数ステップにわたるタスクをユーザーが継続的に指示しなくても進め続けます。また、曖昧な指示をみずから解消しながら目標に近づく能力も備えています。つまり「提案して承認を待つ」から「実行して報告する」へと役割が変わりました。(参考: Introducing GPT-5.5 | OpenAI)

ChatGPT 5.5、GPT-5.2-Codex、GPT-5.3-Codexの役割分担

GPT-5.5ファミリーには、用途によって使い分けるべきモデルが存在します。それぞれの特性を整理すると以下のとおりです。

| モデル | 主な用途 | コンテキスト |

|---|---|---|

| GPT-5.5 | 汎用エージェント・長文処理・Workspace Agents | 約105万トークン |

| GPT-5.2-Codex | 長期推論・大規模コード変換・セキュリティ解析 | 約40万トークン |

| GPT-5.3-Codex | 高速コーディング・フルスタック開発・リアルタイム編集 | 約100万トークン |

GPT-5.2-Codexはセキュリティ脆弱性の分析・修復に特化して訓練されています。一方でGPT-5.3-Codexはフロンティアコーディング性能と高度な推論を1つのモデルに統合し、25%高速化されています。(参考: Introducing GPT-5.2-Codex | OpenAI)

105万トークン・コンテキストで扱える作業範囲

GPT-5.5はAPI経由で約105万トークンのコンテキストウィンドウを利用できます。これにより、大規模なコードベース全体を1リクエストで読み込ませた解析が可能になります。

さらに長文文書の処理性能も大幅に向上しています。512K〜1Mトークン帯の検索・参照性能を測るMRCR v2スコアは、GPT-5.4の36.6%からGPT-5.5では74.0%へと37ポイント改善しました。つまり、大量のドキュメントを参照しながら精度高く回答できるようになっています。(参考: OpenAI releases GPT-5.5 | TechCrunch)

実行型AIとは何か:提案から作業完遂への進化

ファイル操作・コマンド実行・Git操作までAIが担う意味

従来のAIアシスタントはコードを生成して「あとは自分で実行してください」という流れが一般的でした。しかし実行型AIは違います。ファイルの読み書き・コマンド実行・Gitコミットまでをみずから行います。

この変化が意味するのは、「コードを書く作業」だけでなく「開発の一連の手順」をAIが担えるということです。そのため、エンジニアは設計と判断に集中でき、繰り返し作業からの解放が現実になります。(参考: Introducing upgrades to Codex | OpenAI)

Computer UseでOSやデスクトップアプリを跨ぐ作業が可能になる

2026年4月のアップデートで、Codexはデスクトップアプリへのアクセスを可能にするComputer Use機能を搭載しました。具体的には、AIがスクリーンを見てカーソルを動かし、任意のMacアプリ内でクリック・入力を行えます。

さらに、複数のエージェントを並行して動かしながら、人間が別の作業を続けられる設計になっています。つまり「AIがバックグラウンドで作業し、結果を報告する」という働き方が可能になっています。これは従来の「チャットで質問して待つ」スタイルとは本質的に異なります。

MCPによる外部ツール・データソース連携

MCP(Model Context Protocol)は、CodexがブラウザやFigmaなど外部ツールと連携するためのプロトコルです。~/.codex/config.toml にSTDIOまたはStreaming HTTPサーバーを設定することで接続できます。

2026年4月のCodexアップデートでは90以上のプラグインが追加されました。Atlassian Rovo・CircleCI・GitLab Issuesなど実務で使われるサービスと連携できます。また、これらのプラグインはシンプルなAPIラッパーではなく、スキル・アプリ統合・MCPサーバーを組み合わせたチームワークフローの共有基盤として設計されています。(参考: Model Context Protocol – Codex | OpenAI Developers)

Codex CLIとデスクトップ統合で開発ワークフローはどう変わるか

Codex CLI v0.128.0の特徴とターミナルエージェント化

Codex CLIはターミナルから直接動作するAIコーディングエージェントです。npmまたはHomebrewで導入でき、macOS・Windows・Linuxで動作します。

# npmでインストール

npm i -g @openai/codex

# Homebrewでインストール(macOS)

brew install codex

# 最新版へのアップグレード

npm i -g @openai/codex@latestv0.128.0(2026年4月30日リリース)ではMCP/プラグインの安定性が強化されています。具体的には、stdioサーバーのクリーンアップ・プラグインMCP承認の永続化・カスタムMCPメタデータの分離が修正されました。また、GPT-5.5対応のOpenAI Docsスキルが更新されています。(参考: Changelog – Codex | OpenAI Developers)

主な機能は以下のとおりです。

- 対話型のターミナルUIセッションで動作

- GPT-5.4・GPT-5.3-Codexなど複数モデルから選択可能

- スクリーンショットや設計仕様書の画像入力に対応

- CLI内での画像生成・編集が可能

- Webサーチで最新情報の取得が可能

- 繰り返し作業のスクリプト化が可能

バグ特定からテスト、Git操作、PR作成までの実録フロー

Codex CLIを使った典型的な開発フローを紹介します。以下はバグ修正からPR作成までを1コマンドで指示する例です。

# バグ修正からテスト追加・PRまでを1ターンで依頼する例

codex "src/payment.py の決済エラー処理を確認し、

バグを特定してテストを追加してから、

'fix: 決済エラーハンドリングを修正' というメッセージでコミットして

feature/fix-payment-error ブランチのPRを作成してください"このコマンドを受け取ったCodexは、コードの読み込み・問題の特定・修正・テスト実行・Gitコミット・PR作成を順に実行します。そのため、エンジニアはPRのレビューに集中できます。

GitHub ActionsとCodex CLIを組み合わせると、Issue駆動の自動開発フローも実現できます。Issueが作成されると自動でCodexが修正を提案し、PRとして提出されるワークフローを構築可能です。(参考: Codex CLI – OpenAI Developers)

ローカル環境とクラウドAIを組み合わせる設計

Codex CLIはローカルのターミナルで動作しながら、バックエンドでOpenAIのクラウドAPIを利用します。この設計により、ローカルのファイルシステムへのアクセスとクラウドの推論能力を組み合わせた開発が可能です。

一方、Codex Webアプリはクラウド上でエージェントが動作し、ユーザーがオフラインの間も作業を継続します。つまり用途に応じて「ローカル実行(CLI)」と「クラウド実行(Web)」を使い分ける設計が推奨されます。

フロントエンド開発を変えるNative Browser Integration

内蔵ブラウザでUIの挙動をAIが直接確認する流れ

Codexに搭載されたNative Browser Integrationは、アプリ内ブラウザをCodexと人間が共有するビューとして提供します。ローカルの開発サーバーやWebページをブラウザに読み込み、視覚的なコメントを付けて指示を出せます。

Browserプラグインが有効な状態では、Codexはこの内蔵ブラウザを操作できます。具体的には、クリック・テキスト入力・DOM状態の確認・スクリーンショットの取得と検証が可能です。そのため、UIの挙動を確認しながら修正するサイクルをAIが担えます。

スクリーンショット・クリック・フォーム操作を使った修正サイクル

フロントエンド開発において、これまで「動かして確認する」作業は人間が担っていました。Native Browser Integrationにより、このサイクルの一部をAIに委譲できます。

具体的な修正サイクルは以下のとおりです。

- 開発サーバーをブラウザに読み込む

- AIがスクリーンショットを撮影して現在の状態を確認する

- 問題箇所をクリックまたはDOMを検査して特定する

- コードを修正して再レンダリングを確認する

- 期待通りの結果になるまで繰り返す

このサイクルをAIが自律で回すことで、「修正→確認→再修正」の繰り返し作業が大幅に短縮されます。

人間がレビューすべき境界とAIに任せやすい作業

Browser Integrationを活用するうえで、委譲範囲の設計は重要です。AIに任せやすい作業と人間がレビューすべき箇所を明確に分けることで、品質を担保できます。

AIに任せやすい作業: 既存UIのレイアウト崩れ修正、スタイル調整、フォームバリデーションの追加、既知のバグ修正

人間がレビューすべき箇所: ユーザー体験に関わる設計判断、アクセシビリティへの影響、セキュリティに関連するフォーム処理、外部APIとの連携ロジック

Thinking ModeとSelf-Verificationの使い分け

速度を優先する場面と精度を優先する場面

GPT-5.5は通常モードとThinking Modeを使い分けられます。通常モードは応答速度が速く、定型的なコード補完や単純な質問回答に向いています。一方でThinking Modeは複雑な目標を分解し、ツールを使い、複数ステップのタスクを自律で進めるモードです。

速度優先のケースはリアルタイムのコード補完・単一ファイルの修正・定型的な変換作業です。精度優先のケースはアーキテクチャ設計の検討・セキュリティ脆弱性の分析・複数ファイルをまたぐリファクタリングが該当します。(参考: GPT-5 is here | OpenAI)

自己検証でハルシネーションはどこまで減らせるか

GPT-5.5が備えるSelf-Verification(自己検証)機能は、生成した回答をモデル自身が確認・修正するプロセスです。これにより、特に長文コンテキストでの精度が向上しています。

Terminal-Bench 2.0での評価では82.7%という業界最高水準のスコアを達成しています。これはGPT-5.4の75.1%から7.6ポイント改善した結果です。ただし、SWE-Bench Proでの実世界GitHubイシュー解決ではClaude Opus 4.7(64.3%)に対してGPT-5.5(58.6%)とまだ差があります。つまり、自己検証でハルシネーションは確実に減っているものの、完全には排除できていません。

実務で使うなら検証コマンドとレビュー観点をセットにする

AIの自己検証に頼るだけでなく、人間側も検証の仕組みを組み込むことが重要です。以下の例のように、Codexへの指示に検証ステップをセットで含めると品質が安定します。

# 修正と検証をセットで依頼するプロンプト例

codex "src/auth.py のトークン検証ロジックを修正してください。

修正後は以下を確認してください:

1. uv run pytest tests/test_auth.py -v を実行してすべてのテストがPASSすること

2. 既存の認証フローに影響がないことをエラーログで確認すること

3. 型ヒントとdocstringを更新すること"このようにレビュー観点を明示することで、AIの自己検証と人間の確認を組み合わせた二重チェックが実現できます。また、CIに組み込んで自動で失敗したテストを検出するフローと組み合わせると、さらに効果的です。

導入前に考えるべきROI・セキュリティ・人材への影響

API単価より開発時間削減で見るコスト対効果

GPT-5.5はChatGPT Plus・Pro・Business・Enterpriseプランで2026年4月23日から利用可能です。API利用の場合はトークン単価が発生しますが、ROIを考えるときはAPI単価より開発時間削減の観点で試算するほうが実態に合います。

たとえば、1時間かかっていたバグ調査が10分に短縮された場合、エンジニアの時間コストを換算するとAPIコストを大きく上回る効果が得られます。また、GPT-5.5は前モデルより少ないトークンと再試行回数で高品質な出力に到達するため、実質的なAPI利用コストは抑えられる傾向があります。

Computer Useの自律操作で注意すべき権限と監査

Computer Use機能はAIが画面を操作するため、権限管理と監査ログが重要です。注意すべきポイントを整理します。

- 最小権限原則: AIエージェントには必要最小限の権限のみ付与する

- サンドボックス環境での検証: 本番環境への適用前に隔離環境でテストする

- 操作ログの記録: AIが行った操作を監査できるようにログを保存する

- 機密情報の除外: 認証情報・APIキー・個人情報を含む画面では使用を制限する

特に企業利用では、Workspace AgentsがGoogleドライブなど外部サービスと連携するため、データアクセス範囲の明確化が必要です。(参考: GPT-5.5 System Card | OpenAI)

エントリーエンジニアに求められる役割はどう変わるか

実行型AIの登場により、単純なコード実装タスクはAIが担えるようになっています。しかし、エンジニアが不要になるわけではありません。求められる役割が変わっています。

エントリーエンジニアにこれから重要なスキルは以下の3つです。

- AIへの指示設計力: 明確な要件を自然言語で記述し、意図通りの出力を引き出す能力

- AIの出力レビュー力: 生成されたコードの品質・セキュリティ・設計上の問題を見抜く能力

- システム設計力: 全体のアーキテクチャを設計し、AIの作業範囲を適切に分解する能力

自然言語だけで完結するか、学習すべきスキルは何か

「自然言語だけで開発できる」という期待がありますが、現時点では過信は禁物です。自然言語の指示は曖昧さを含むため、AIが意図と異なる解釈をすることがあります。そのため、基礎的なプログラミング知識とコードを読む能力は依然として必要です。

一方で、学習の優先度が変わっています。暗記的なAPI知識よりも、「どんな問題をどう分解するか」という問題解決の論理構造のほうが価値が上がっています。

とつブログ的おすすめ活用パターン

既存リポジトリの調査・影響範囲分析に使う

Codexを使った最初のステップとして、既存コードベースの調査が効果的です。105万トークンのコンテキストを活かすと、大規模なリポジトリ全体を読み込んで影響範囲を分析できます。

具体的には「この関数を変更した場合、影響を受けるファイルと箇所を列挙してください」という指示で、リファクタリング前の調査が短時間で完了します。また、技術的負債の特定やセキュリティ上の懸念箇所の抽出にも活用できます。

関連記事: Codexサブエージェント完全ガイド

小さなバグ修正からテスト付きで任せる

最初から大きなタスクを委譲するのではなく、小さなバグ修正からスタートするのがおすすめです。特に「テストも一緒に追加してください」という指示をセットにすることで、修正の品質確認ができます。

慣れてきたら、複数の関連する修正をまとめて依頼するフローへ移行します。さらに、GitHub ActionsとCodex CLIを連携させることで、Issue駆動の自動修正フローを構築できます。段階的に委譲範囲を広げることが、品質と速度を両立させるコツです。

サブエージェント・Plugin・MCPで作業を分離する

複雑なタスクは複数のエージェントや機能に分離することで管理しやすくなります。たとえば、調査・実装・テスト・ドキュメント作成をそれぞれ別のサブエージェントに担わせる設計が効果的です。

また、筆者が実際に活用していて便利だと感じるのが、ChatGPT 5.5のArtifactsビュー機能です。生成したコード・画像・プロンプトがサイドバーに常に表示された状態で作業できるため、チャットの流れが長くなっても文脈を失いません。特にプロンプトを繰り返し改善しながら画像生成の精度を上げる作業では、前回の結果をすぐ参照できることが大きな利点でした。作業の文脈をAIとの間で共有したまま進められるのは、長時間の開発タスクで特に効いています。

MCPサーバーを活用すると、Codexが外部のデータソースや社内ツールと直接連携できます。たとえば、Jira・GitLab・Confluenceとの連携により、タスク管理と実装を一元化したフローが構築できます。(参考: Codex Plugin完全ガイド)

関連記事: ChatGPT カスタムプロンプト最適化ガイド

まとめ:ChatGPT 5.5 Codex 新機能で変わる開発の現実

ChatGPT 5.5とCodexの新機能は、AIが「提案するだけのツール」から「実際に作業を完遂するエージェント」へと転換した重要な節目です。以下にこの記事の要点を整理します。

- GPT-5.5は約105万トークンのコンテキストと自律エージェント機能を備え、2026年4月23日に正式リリース

- GPT-5.2-Codexは大規模コード変換とセキュリティ解析に特化し、GPT-5.3-Codexはフロンティアコーディング性能を25%高速化した統合モデル

- Computer UseでAIがデスクトップ全体を操作できるようになり、バックグラウンド実行も可能

- Native Browser Integrationでフロントエンド修正サイクルをAIが担えるようになった

- MCPによる外部ツール連携と90以上のプラグインで実務フロー全体を接続可能

- Codex CLI v0.128.0はバグ修正からテスト・Git・PR作成までをターミナルから一気通貫で指示できる

- 導入時は最小権限・サンドボックス検証・監査ログのセキュリティ設計が必須

- エンジニアに求められるのは「AIへの指示設計力」と「出力レビュー力」と「システム設計力」

段階的な導入が成功の鍵です。まず既存リポジトリの調査・影響範囲分析からはじめ、小さなバグ修正を委譲し、慣れたらサブエージェントとMCPで作業範囲を広げていく順序が現実的です。

あわせて読みたいおすすめ書籍

ChatGPT 5.5やCodexなどのAIコーディングエージェントをさらに深めたい方には、以下の書籍がおすすめです。

引用・出典

- Introducing GPT-5.5 | OpenAI

- GPT-5.5 System Card | OpenAI

- Introducing GPT-5.2-Codex | OpenAI

- Introducing upgrades to Codex | OpenAI

- Codex CLI – OpenAI Developers

- OpenAI releases GPT-5.5, bringing company one step closer to an AI ‘super app’ | TechCrunch

- GPT-5 is here | OpenAI

- Model Context Protocol – Codex | OpenAI Developers

- Changelog – Codex | OpenAI Developers

コメント